隱式分配與 GC 停頓:OpenResty XRay 破解 D 語言訂單服務 P99 異常抖動

一個穩定執行數月的訂單服務(D 語言 + vibe.d)開始出現 P99 響應時間的週期性抖動。

問題特徵:

- P99 響應時間:在流量高峰時段,從基線 120ms 抖動到 350ms,部分使用者體感明顯。

- 常規監控:錯誤率、吞吐量、平均響應時間、慢查詢日誌均無異常。

- 外部依賴:健康檢查全部透過,呼叫鏈路耗時分佈正常。

- 服務狀態:無 OOM、無 panic。

這是效能問題中最難處理的一類:表象健康,內部異常。常規監控告訴你有問題,但不告訴你問題在哪裡。資料庫、外部依賴、併發配置——經驗驅動的排查方向逐一走完,P99 沒有任何改善。當所有看起來合理的假設都不成立,說明問題不在某個外部元件,而在服務自身的執行時行為。

為了在不干擾生產環境的前提下定位根因,我們執行了 OpenResty XRay。由於其具無侵入的特性,透過動態追蹤技術,無需修改一行程式碼、無需重新編譯、更無需重啟服務,直接對執行中的二進位制程序進行取樣分析,自動生成火焰圖以排查效能熱點。

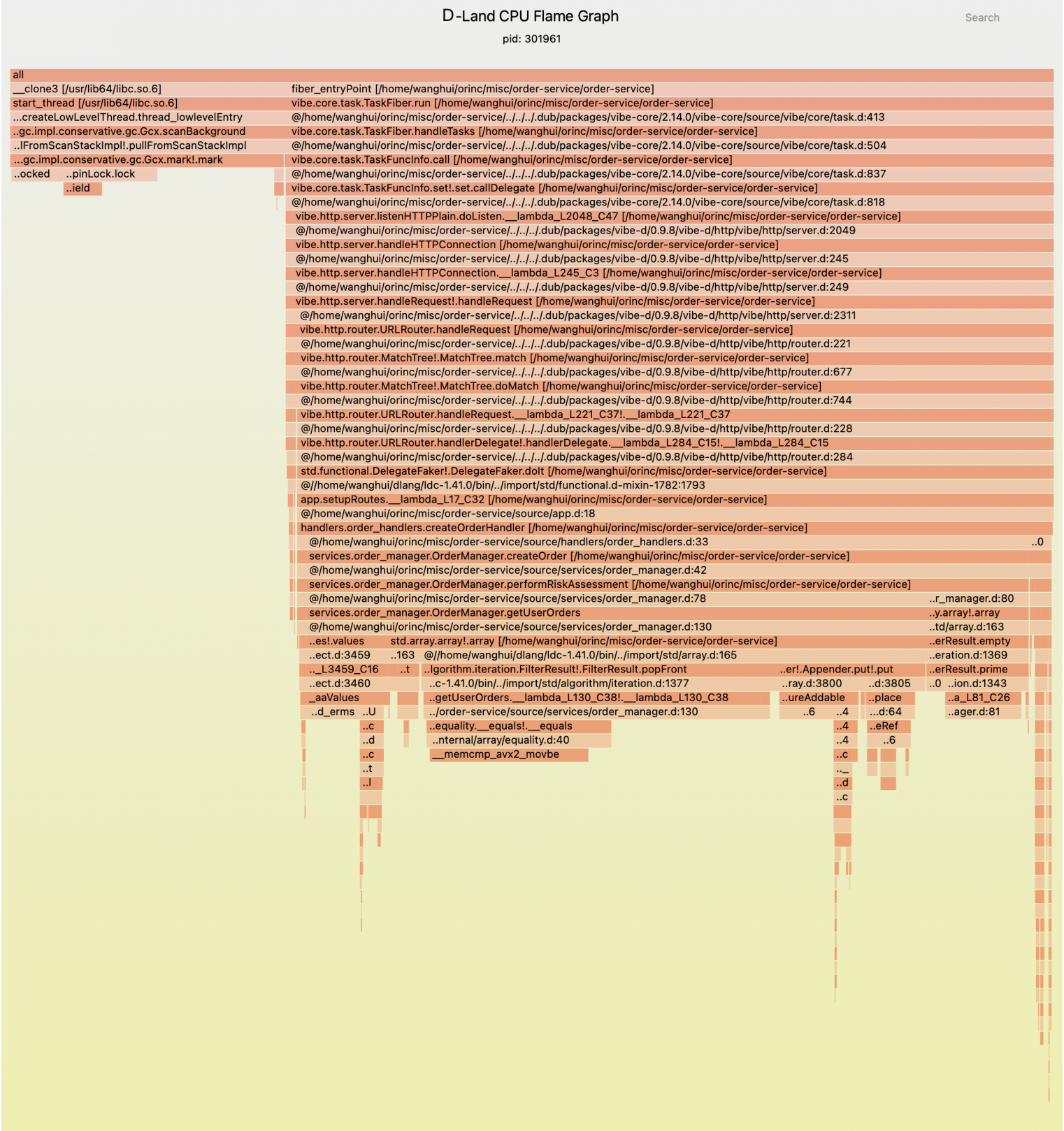

火焰圖中的 GC 陷阱與業務熱點解讀

OpenResty XRay 採集並自動生成的火焰圖開啟的瞬間,2 個寬塊立刻吸引了注意:

- 業務邏輯呼叫棧 (

OrderManager相關):~73% - GC 相關呼叫棧 (

Gcx.scanBackground):~26%

直覺陷阱: 絕大多數工程師會把注意力集中在 73% 的業務邏輯上,認為把業務程式碼最佳化好,GC 自然會好。

為甚麼這個直覺是錯的:

GC 停頓會拉長業務程式碼的取樣視窗。 當 GC 在後臺掃描記憶體時,業務執行緒處於等待狀態。如果 GC 觸發的時機恰好在業務執行期間,業務程式碼會被“多采樣”不是因為業務本身更慢,而是因為 GC 拉長了業務程式碼的實際執行視窗。

應該先理解 GC。這是系統級行為,它的存在會影響所有業務熱點的解讀方式。兩個數字不能簡單相加,也不能按字面大小排優先順序。

第一個熱點:GC 佔了 26.4%——但這不只是「GC 慢」的問題

火焰圖中,GC 的呼叫棧頂端是 core.internal.gc.impl.conservative.gc.Gcx.scanBackground。關鍵詞是 conservative(保守式)。

D 語言的 GC 是保守式的,與 JVM/Go 的精確 GC 不同:

- 精確 GC:知道記憶體中哪些值是指標,哪些是普通整數,可以精確回收。

- 保守式 GC:無法區分“指標”和“恰好像指標的整數”。面對歧義,它選擇保守處理:假設它是指標,不回收其指向的記憶體。

舉例:

// 一個時間戳或 ID,其值在記憶體中可能看起來像一個合法的指標地址

ulong id = 0x7f8a4c001234;

// 保守式 GC 看到這個值,可能誤認為是指向 0x7f8a4c001234 的指標,

// 從而導致該地址的記憶體(如果存在)無法被回收。

在高頻分配場景下,這會形成一個危險的正反饋: 高頻分配臨時物件 → 產生更多「偽指標」→ 更多記憶體無法被及時回收 → 堆越來越大 → 下一輪 GC 掃描時間越來越長 → 正反饋

在 JVM 中,調大堆可以延緩 Young GC 的觸發頻率,但代價是單次 Full GC 停頓更長——這本身就是一個需要權衡的調優決策。而在 D 的保守式 mark-and-sweep GC 下,情況更糟:GC 無法精確識別指標,必須逐字掃描整個堆,堆越大、掃描時間越長,停頓時間幾乎與堆大小線性相關。

在 vibe.d 的 fiber 模型下,每個併發請求都會產生大量堆上分配(請求 closure、動態 buffer、字串拼接等),這些物件不斷累積,既加重了 GC 的掃描負擔,也讓觸發時機更加難以預測。“調大堆”這條在 JVM 下尚且存疑的調優路徑,在 D 語言下幾乎是反效果的。

最佳化方向:減少 GC 的工作量,而不是最佳化 GC 的工作方式。

| 優先順序 | 方法 | 適用場景 | 程式碼示例 |

|---|---|---|---|

| 高 | @nogc 標註熱路徑 | 關鍵函式可以完全避免堆分配 | @nogc void processOrderFast(...) |

| 中 | 物件池複用 | 生命週期短、分配頻繁的物件 | auto order = orderPool.acquire(); |

| 低 | 預分配緩衝區 | 輸出大小可預測的場景 | appender.reserve(4096); |

最大熱點:getUserOrders 的 59.4%,根因在資料結構

火焰圖顯示,services.order_manager.OrderManager.getUserOrders 佔據了 59.4% 的 CPU 時間,是最大的效能熱點。

只看函式名,結論是:訂單查詢慢。但怎麼最佳化?必須向下展開呼叫棧。

getUserOrders (59.4%)

└─ std.algorithm.iteration.FilterResult ← 陣列過濾迭代

└─ __memcmp_avx2_movbe (15.2%) ← 記憶體比較指令

根因鏈路清晰了:

getUserOrders遍歷了全量訂單陣列,這是一個 O(n) 的線性掃描。- 對每個訂單的

userId欄位執行字串比較(__memcmp_avx2_movbe)。 - 將過濾出的訂單複製到新的結果陣列中。

這個問題在程式碼審查中幾乎不可見。函式體簡潔,邏輯清晰。只有在真實的高併發負載下,當 n(訂單總量)足夠大,這個 O(n) 的代價才會被放大到驚人的 59.4%。

最佳化方案:用空間換時間,建立使用者維度的索引。

// 最佳化前:O(n) 線性掃描,每次查詢遍歷全量訂單

auto getUserOrders(string userId) {

return allOrders.filter!(o => o.userId == userId).array;

}

// 最佳化後:O(1) 雜湊查詢

private Order[][string] userOrdersIndex;

auto getUserOrders(string userId) {

if (auto orders = userId in userOrdersIndex) {

return *orders; // 直接返回預先構建好的訂單列表

}

return [];

}

權衡分析:

- 收益:查詢複雜度從 O(n) 降到 O(1),預期將此熱點的 CPU 佔比從 59.4% 降至 < 5%。

- 代價:

- 記憶體開銷:需要額外記憶體維護

userOrdersIndex。 - 寫入同步:在訂單建立/更新時需要同步維護索引。

- 記憶體開銷:需要額外記憶體維護

- 適用場景:讀多寫少的業務(本案例讀寫比約 100:1),這個權衡幾乎總是成立的。

生產實現注意事項:

- 索引的併發寫入安全性(需要加鎖或使用

shared型別)。 - 訂單狀態變更時的索引同步邏輯。

- 服務重啟時的索引冷啟動策略。

其他熱點:Appender 的 14.2% 與 JSON 的 ~8%

std.array.Appender:被忽視的記憶體分配放大器

火焰圖顯示,std.array.Appender 相關呼叫佔了 14.2%。它的影響遠不止於自身。

關鍵洞察: Appender 和 GC 在火焰圖上看起來是兩個獨立的熱點,實際上是同一個問題在不同層面的投影。

因果鏈:

Appender 頻繁追加小資料

↓

容量不足,觸發動態擴容

↓

分配新的更大記憶體塊,並複製舊資料

↓

舊記憶體塊成為待回收的垃圾

↓

GC 掃描和回收壓力增加 (26.4%)

最佳化方向: 在已知資料規模的場景下預先呼叫 reserve() 分配容量,消除執行時的動態擴容。

JSON 序列化:~8% 的分散成本

JSON 處理的開銷分散在 parseJson、serializeToJson 等多個函式,合計約 8%。由於其分散的特點,它在火焰圖上不會形成單一的顯眼熱點,容易被漏掉,但累計成本不可低估。在資源有限時,應排在更高優先順序的最佳化之後處理。

最佳化路線圖:為甚麼順序比動作更重要

確定了所有熱點之後,先最佳化哪個?順序錯誤,不只是效率低,而是會導致先做的最佳化被後做的問題抵消。

| 優先順序 | 熱點 | 佔比 | 判斷依據 |

|---|---|---|---|

| 高 | GC + getUserOrders | 26.4% + 59.4% | 兩者存在因果耦合,必須同步最佳化,能帶來數量級的提升。 |

| 中 | Appender | 14.2% | 它的真實權重依賴 GC 最佳化後的重新取樣結果。 |

| 低 | JSON 序列化 | ~8% | 潛在收益有限,且替換方案的工程成本較高。 |

每一步最佳化之後,必須重新取樣

火焰圖是特定負載下的快照。最佳化行為會改變系統的熱點分佈。依賴第一張火焰圖規劃所有後續步驟,是一個常見錯誤。例如,GC 壓力降低後,原本被 GC 停頓「抬高」的 Appender 取樣比例會下降,其真實權重才能被準確評估。

經過上述分析和最佳化,我們取得了顯著的效能提升。

| 指標 | 最佳化前 | 最佳化後 | 改善幅度 |

|---|---|---|---|

| P99 響應時間 | 350ms | 95ms | ↓ 73% |

| GC 佔比 | 26.4% | 6.2% | ↓ 76% |

| getUserOrders 佔比 | 59.4% | 3.1% | ↓ 95% |

| Appender 佔比 | 14.2% | 4.8% | ↓ 66% |

結語:從程式碼邏輯到執行時真相

回顧本次案例,最值得覆盤的並非那個 O(n) 的演算法失誤,而是為何在程式碼審查完善、常規監控齊全的情況下,問題依然隱匿了數月之久?

這揭示了現代軟體工程中的一個核心盲區:靜態的程式碼質量不等於動態的執行時效能。

getUserOrders 的邏輯在單元測試和低負載下是完全正確的,常規監控面板上的宏觀指標也掩蓋了微觀的抖動。然而,在真實流量的衝擊下,資料規模的量變與 D 語言 GC 機制發生耦合,引發了效能質變。這種由“程式碼 + 資料 + 執行時”三者互動產生的複雜問題,是靜態分析和傳統埋點監控無法觸達的。

OpenResty XRay 在此案例中體現了兩個關鍵的技術價值:

- 非侵入式的全鏈路透視:它不需要開發人員預先埋點(埋點往往帶有主觀預判),也不需要修改程式碼或重啟服務。它直接在生產環境對執行中的程序進行動態追蹤,還原了程式碼在真實負載下、微秒級別的執行路徑。

- 提供最佳化的“確定性”:在效能排查中,最大的成本往往是方向錯誤的試錯。本案例中,如果沒有火焰圖提供的精確資料,團隊極易陷入盲目調大堆記憶體的經驗主義誤區,而在 D 語言的保守式 GC 機制下,這恰恰會適得其反。OpenResty XRay 將模糊的 P99 抖動量化為精確的函式級耗時和 GC 佔比,讓技術決策基於資料而非猜測。

效能最佳化本質上是對系統資源的重新分配。OpenResty XRay 穿透了業務邏輯的表象,直接觀測到底層的執行時行為。在日益複雜的分散式系統中,建立一種基於證據的效能治理能力。

關於 OpenResty XRay

OpenResty XRay 是一款動態追蹤產品,它可以自動分析執行中的應用,以解決效能問題、行為問題和安全漏洞,並提供可行的建議。在底層實現上,OpenResty XRay 由我們的 Y 語言驅動,可以在不同環境下支援多種不同的執行時,如 Stap+、eBPF+、GDB 和 ODB。

關於作者

章亦春是開源 OpenResty® 專案創始人兼 OpenResty Inc. 公司 CEO 和創始人。

章亦春(Github ID: agentzh),生於中國江蘇,現定居美國灣區。他是中國早期開源技術和文化的倡導者和領軍人物,曾供職於多家國際知名的高科技企業,如 Cloudflare、雅虎、阿里巴巴, 是 “邊緣計算“、”動態追蹤 “和 “機器程式設計 “的先驅,擁有超過 22 年的程式設計及 16 年的開源經驗。作為擁有超過 4000 萬全球域名使用者的開源專案的領導者。他基於其 OpenResty® 開源專案打造的高科技企業 OpenResty Inc. 位於美國矽谷中心。其主打的兩個產品 OpenResty XRay(利用動態追蹤技術的非侵入式的故障剖析和排除工具)和 OpenResty Edge(最適合微服務和分散式流量的全能型閘道器軟體),廣受全球眾多上市及大型企業青睞。在 OpenResty 以外,章亦春為多個開源專案貢獻了累計超過百萬行程式碼,其中包括,Linux 核心、Nginx、LuaJIT、GDB、SystemTap、LLVM、Perl 等,並編寫過 60 多個開源軟體庫。

關注我們

如果您喜歡本文,歡迎關注我們 OpenResty Inc. 公司的部落格網站 。也歡迎掃碼關注我們的微信公眾號:

翻譯

我們提供了英文版原文和中譯版(本文)。我們也歡迎讀者提供其他語言的翻譯版本,只要是全文翻譯不帶省略,我們都將會考慮採用,非常感謝!