隐式分配与 GC 停顿:OpenResty XRay 破解 D 语言订单服务 P99 异常抖动

一个稳定运行数月的订单服务(D 语言 + vibe.d)开始出现 P99 响应时间的周期性抖动。

问题特征:

- P99 响应时间:在流量高峰时段,从基线 120ms 抖动到 350ms,部分用户体感明显。

- 常规监控:错误率、吞吐量、平均响应时间、慢查询日志均无异常。

- 外部依赖:健康检查全部通过,调用链路耗时分布正常。

- 服务状态:无 OOM、无 panic。

这是性能问题中最难处理的一类:表象健康,内部异常。常规监控告诉你有问题,但不告诉你问题在哪里。数据库、外部依赖、并发配置——经验驱动的排查方向逐一走完,P99 没有任何改善。当所有看起来合理的假设都不成立,说明问题不在某个外部组件,而在服务自身的运行时行为。

为了在不干扰生产环境的前提下定位根因,我们运行了 OpenResty XRay。由于其具无侵入的特性,通过动态追踪技术,无需修改一行代码、无需重新编译、更无需重启服务,直接对运行中的二进制进程进行采样分析,自动生成火焰图以排查性能热点。

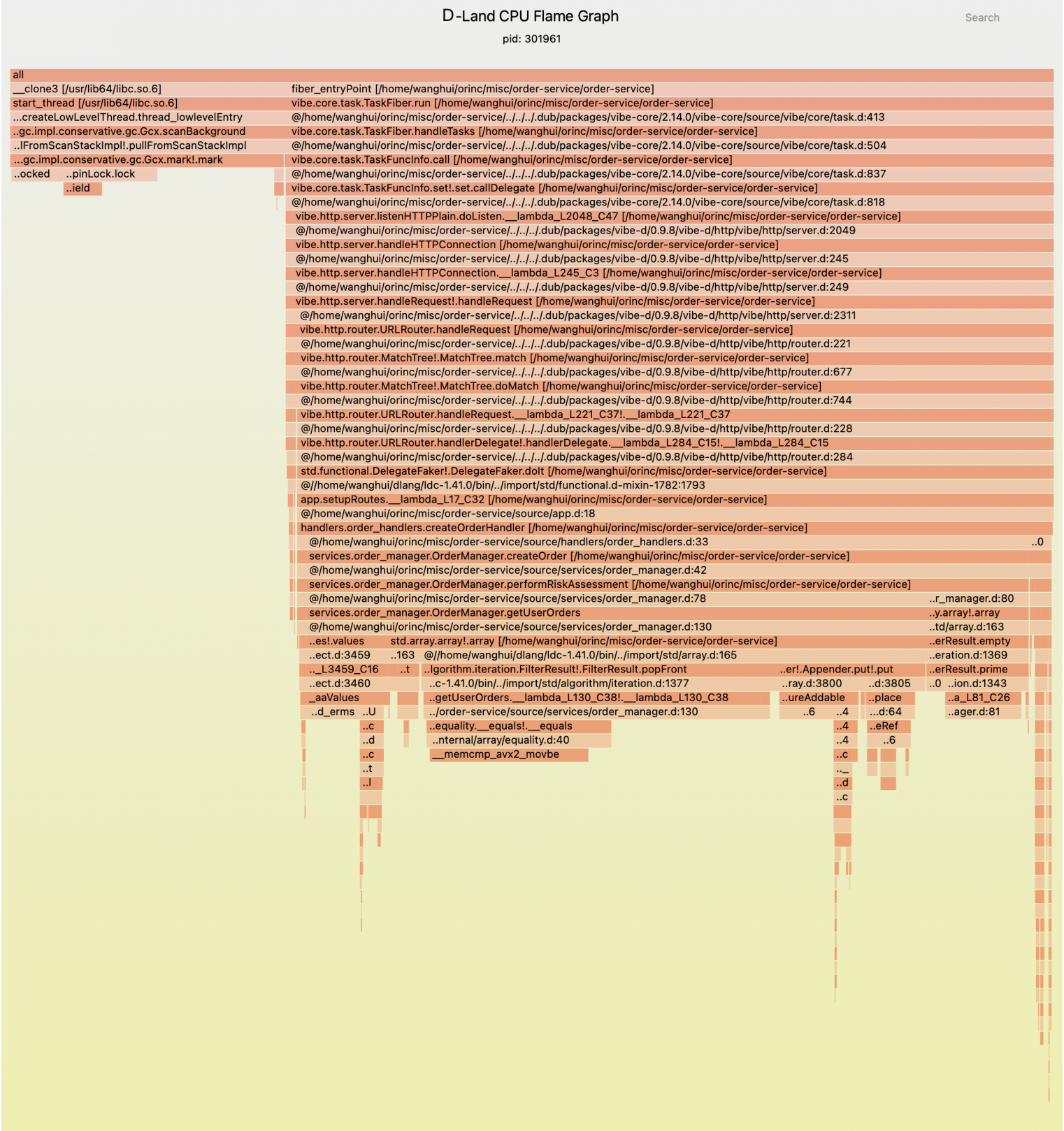

火焰图中的 GC 陷阱与业务热点解读

OpenResty XRay 采集并自动生成的火焰图打开的瞬间,2 个宽块立刻吸引了注意:

- 业务逻辑调用栈 (

OrderManager相关):~73% - GC 相关调用栈 (

Gcx.scanBackground):~26%

直觉陷阱: 绝大多数工程师会把注意力集中在 73% 的业务逻辑上,认为把业务代码优化好,GC 自然会好。

为什么这个直觉是错的:

GC 停顿会拉长业务代码的采样窗口。 当 GC 在后台扫描内存时,业务线程处于等待状态。如果 GC 触发的时机恰好在业务执行期间,业务代码会被“多采样”不是因为业务本身更慢,而是因为 GC 拉长了业务代码的实际执行窗口。

应该先理解 GC。这是系统级行为,它的存在会影响所有业务热点的解读方式。两个数字不能简单相加,也不能按字面大小排优先级。

第一个热点:GC 占了 26.4%——但这不只是「GC 慢」的问题

火焰图中,GC 的调用栈顶端是 core.internal.gc.impl.conservative.gc.Gcx.scanBackground。关键词是 conservative(保守式)。

D 语言的 GC 是保守式的,与 JVM/Go 的精确 GC 不同:

- 精确 GC:知道内存中哪些值是指针,哪些是普通整数,可以精确回收。

- 保守式 GC:无法区分“指针”和“恰好像指针的整数”。面对歧义,它选择保守处理:假设它是指针,不回收其指向的内存。

举例:

// 一个时间戳或 ID,其值在内存中可能看起来像一个合法的指针地址

ulong id = 0x7f8a4c001234;

// 保守式 GC 看到这个值,可能误认为是指向 0x7f8a4c001234 的指针,

// 从而导致该地址的内存(如果存在)无法被回收。

在高频分配场景下,这会形成一个危险的正反馈: 高频分配临时对象 → 产生更多「伪指针」→ 更多内存无法被及时回收 → 堆越来越大 → 下一轮 GC 扫描时间越来越长 → 正反馈

在 JVM 中,调大堆可以延缓 Young GC 的触发频率,但代价是单次 Full GC 停顿更长——这本身就是一个需要权衡的调优决策。而在 D 的保守式 mark-and-sweep GC 下,情况更糟:GC 无法精确识别指针,必须逐字扫描整个堆,堆越大、扫描时间越长,停顿时间几乎与堆大小线性相关。

在 vibe.d 的 fiber 模型下,每个并发请求都会产生大量堆上分配(请求 closure、动态 buffer、字符串拼接等),这些对象不断累积,既加重了 GC 的扫描负担,也让触发时机更加难以预测。“调大堆”这条在 JVM 下尚且存疑的调优路径,在 D 语言下几乎是反效果的。

优化方向:减少 GC 的工作量,而不是优化 GC 的工作方式。

| 优先级 | 方法 | 适用场景 | 代码示例 |

|---|---|---|---|

| 高 | @nogc 标注热路径 | 关键函数可以完全避免堆分配 | @nogc void processOrderFast(...) |

| 中 | 对象池复用 | 生命周期短、分配频繁的对象 | auto order = orderPool.acquire(); |

| 低 | 预分配缓冲区 | 输出大小可预测的场景 | appender.reserve(4096); |

最大热点:getUserOrders 的 59.4%,根因在数据结构

火焰图显示,services.order_manager.OrderManager.getUserOrders 占据了 59.4% 的 CPU 时间,是最大的性能热点。

只看函数名,结论是:订单查询慢。但怎么优化?必须向下展开调用栈。

getUserOrders (59.4%)

└─ std.algorithm.iteration.FilterResult ← 数组过滤迭代

└─ __memcmp_avx2_movbe (15.2%) ← 内存比较指令

根因链路清晰了:

getUserOrders遍历了全量订单数组,这是一个 O(n) 的线性扫描。- 对每个订单的

userId字段执行字符串比较(__memcmp_avx2_movbe)。 - 将过滤出的订单复制到新的结果数组中。

这个问题在代码审查中几乎不可见。函数体简洁,逻辑清晰。只有在真实的高并发负载下,当 n(订单总量)足够大,这个 O(n) 的代价才会被放大到惊人的 59.4%。

优化方案:用空间换时间,建立用户维度的索引。

// 优化前:O(n) 线性扫描,每次查询遍历全量订单

auto getUserOrders(string userId) {

return allOrders.filter!(o => o.userId == userId).array;

}

// 优化后:O(1) 哈希查找

private Order[][string] userOrdersIndex;

auto getUserOrders(string userId) {

if (auto orders = userId in userOrdersIndex) {

return *orders; // 直接返回预先构建好的订单列表

}

return [];

}

权衡分析:

- 收益:查询复杂度从 O(n) 降到 O(1),预期将此热点的 CPU 占比从 59.4% 降至 < 5%。

- 代价:

- 内存开销:需要额外内存维护

userOrdersIndex。 - 写入同步:在订单创建/更新时需要同步维护索引。

- 内存开销:需要额外内存维护

- 适用场景:读多写少的业务(本案例读写比约 100:1),这个权衡几乎总是成立的。

生产实现注意事项:

- 索引的并发写入安全性(需要加锁或使用

shared类型)。 - 订单状态变更时的索引同步逻辑。

- 服务重启时的索引冷启动策略。

其他热点:Appender 的 14.2% 与 JSON 的 ~8%

std.array.Appender:被忽视的内存分配放大器

火焰图显示,std.array.Appender 相关调用占了 14.2%。它的影响远不止于自身。

关键洞察: Appender 和 GC 在火焰图上看起来是两个独立的热点,实际上是同一个问题在不同层面的投影。

因果链:

Appender 频繁追加小数据

↓

容量不足,触发动态扩容

↓

分配新的更大内存块,并复制旧数据

↓

旧内存块成为待回收的垃圾

↓

GC 扫描和回收压力增加 (26.4%)

优化方向: 在已知数据规模的场景下预先调用 reserve() 分配容量,消除运行时的动态扩容。

JSON 序列化:~8% 的分散成本

JSON 处理的开销分散在 parseJson、serializeToJson 等多个函数,合计约 8%。由于其分散的特点,它在火焰图上不会形成单一的显眼热点,容易被漏掉,但累计成本不可低估。在资源有限时,应排在更高优先级的优化之后处理。

优化路线图:为什么顺序比动作更重要

确定了所有热点之后,先优化哪个?顺序错误,不只是效率低,而是会导致先做的优化被后做的问题抵消。

| 优先级 | 热点 | 占比 | 判断依据 |

|---|---|---|---|

| 高 | GC + getUserOrders | 26.4% + 59.4% | 两者存在因果耦合,必须同步优化,能带来数量级的提升。 |

| 中 | Appender | 14.2% | 它的真实权重依赖 GC 优化后的重新采样结果。 |

| 低 | JSON 序列化 | ~8% | 潜在收益有限,且替换方案的工程成本较高。 |

每一步优化之后,必须重新采样

火焰图是特定负载下的快照。优化行为会改变系统的热点分布。依赖第一张火焰图规划所有后续步骤,是一个常见错误。例如,GC 压力降低后,原本被 GC 停顿「抬高」的 Appender 采样比例会下降,其真实权重才能被准确评估。

经过上述分析和优化,我们取得了显著的性能提升。

| 指标 | 优化前 | 优化后 | 改善幅度 |

|---|---|---|---|

| P99 响应时间 | 350ms | 95ms | ↓ 73% |

| GC 占比 | 26.4% | 6.2% | ↓ 76% |

| getUserOrders 占比 | 59.4% | 3.1% | ↓ 95% |

| Appender 占比 | 14.2% | 4.8% | ↓ 66% |

结语:从代码逻辑到运行时真相

回顾本次案例,最值得复盘的并非那个 O(n) 的算法失误,而是为何在代码审查完善、常规监控齐全的情况下,问题依然隐匿了数月之久?

这揭示了现代软件工程中的一个核心盲区:静态的代码质量不等于动态的运行时性能。

getUserOrders 的逻辑在单元测试和低负载下是完全正确的,常规监控面板上的宏观指标也掩盖了微观的抖动。然而,在真实流量的冲击下,数据规模的量变与 D 语言 GC 机制发生耦合,引发了性能质变。这种由“代码 + 数据 + 运行时”三者交互产生的复杂问题,是静态分析和传统埋点监控无法触达的。

OpenResty XRay 在此案例中体现了两个关键的技术价值:

- 非侵入式的全链路透视:它不需要开发人员预先埋点(埋点往往带有主观预判),也不需要修改代码或重启服务。它直接在生产环境对运行中的进程进行动态追踪,还原了代码在真实负载下、微秒级别的执行路径。

- 提供优化的“确定性”:在性能排查中,最大的成本往往是方向错误的试错。本案例中,如果没有火焰图提供的精确数据,团队极易陷入盲目调大堆内存的经验主义误区,而在 D 语言的保守式 GC 机制下,这恰恰会适得其反。OpenResty XRay 将模糊的 P99 抖动量化为精确的函数级耗时和 GC 占比,让技术决策基于数据而非猜测。

性能优化本质上是对系统资源的重新分配。OpenResty XRay 穿透了业务逻辑的表象,直接观测到底层的运行时行为。在日益复杂的分布式系统中,建立一种基于证据的性能治理能力。

关于 OpenResty XRay

OpenResty XRay 是一款动态追踪产品,它可以自动分析运行中的应用,以解决性能问题、行为问题和安全漏洞,并提供可行的建议。在底层实现上,OpenResty XRay 由我们的 Y 语言驱动,可以在不同环境下支持多种不同的运行时,如 Stap+、eBPF+、GDB 和 ODB。

关于作者

章亦春是开源 OpenResty® 项目创始人兼 OpenResty Inc. 公司 CEO 和创始人。

章亦春(Github ID: agentzh),生于中国江苏,现定居美国湾区。他是中国早期开源技术和文化的倡导者和领军人物,曾供职于多家国际知名的高科技企业,如 Cloudflare、雅虎、阿里巴巴, 是 “边缘计算“、”动态追踪 “和 “机器编程 “的先驱,拥有超过 22 年的编程及 16 年的开源经验。作为拥有超过 4000 万全球域名用户的开源项目的领导者。他基于其 OpenResty® 开源项目打造的高科技企业 OpenResty Inc. 位于美国硅谷中心。其主打的两个产品 OpenResty XRay(利用动态追踪技术的非侵入式的故障剖析和排除工具)和 OpenResty Edge(最适合微服务和分布式流量的全能型网关软件),广受全球众多上市及大型企业青睐。在 OpenResty 以外,章亦春为多个开源项目贡献了累计超过百万行代码,其中包括,Linux 内核、Nginx、LuaJIT、GDB、SystemTap、LLVM、Perl 等,并编写过 60 多个开源软件库。

关注我们

如果您喜欢本文,欢迎关注我们 OpenResty Inc. 公司的博客网站 。也欢迎扫码关注我们的微信公众号:

翻译

我们提供了英文版原文和中译版(本文)。我们也欢迎读者提供其他语言的翻译版本,只要是全文翻译不带省略,我们都将会考虑采用,非常感谢!